Inteligența artificială schimbă radical securitatea cibernetică

În ultimele luni, modelele de inteligență artificială au făcut un salt major: de la generarea de erori și „halucinații”, au ajuns să identifice vulnerabilități critice în software-ul care stă la baza internetului și a infrastructurii digitale globale.

Această evoluție deschide noi oportunități pentru securitatea cibernetică, dar și riscuri serioase. Aceleași instrumente pot fi folosite atât de dezvoltatori pentru a repara sisteme, cât și de hackeri sau actori statali pentru a exploata breșe și a lansa atacuri.

Anthropic lansează un model AI cu capabilități fără precedent

Compania Anthropic a anunțat lansarea unui nou model, Mythos Preview, despre care susține că ar putea „redefini securitatea cibernetică”. Modelul este capabil să identifice vulnerabilități severe inclusiv în sisteme de operare și browsere majore și, mai important, să propună metode de exploatare a acestora.

Din cauza riscurilor ridicate, accesul la acest model este extrem de limitat, fiind oferit doar unui grup restrâns de aproximativ 50 de organizații, în cadrul inițiativei Project Glasswing.

Compania a transmis că nu intenționează, cel puțin pentru moment, să facă public acest model, tocmai pentru a preveni utilizarea abuzivă.

Comunitatea IT confirmă saltul tehnologic

Schimbările sunt deja vizibile în rândul dezvoltatorilor care gestionează infrastructuri critice. Daniel Stenberg, creatorul instrumentului open-source cURL, spune că în 2026 calitatea raportărilor de vulnerabilități a crescut dramatic.

Dacă în anii anteriori majoritatea raportărilor generate cu ajutorul AI erau eronate sau inutile, acum situația s-a inversat. Aproximativ 10% dintre raportări indică vulnerabilități reale, iar restul sunt erori legitime care pot fi corectate.

În doar trei luni din 2026, echipa sa a identificat și reparat mai multe vulnerabilități decât în fiecare dintre anii precedenți.

AI depășește capacitatea umană în detectarea bug-urilor

Experți în securitate cibernetică susțin că modelele AI au depășit deja capacitatea umană în identificarea problemelor din cod. Acest lucru accelerează semnificativ procesul de descoperire a breșelor, dar creează și o presiune uriașă asupra dezvoltatorilor, care trebuie să gestioneze un volum mult mai mare de informații.

În același timp, AI nu este încă la fel de eficientă în rezolvarea acestor probleme, deoarece procesul implică decizii complexe și nu doar scriere de cod.

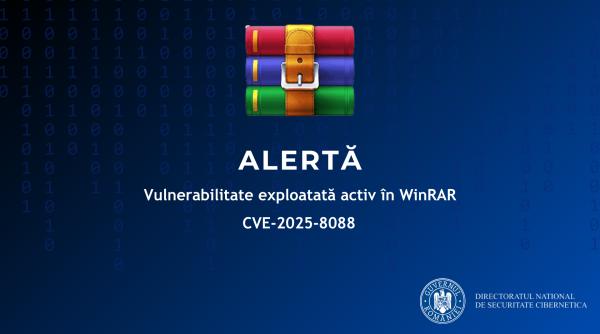

Riscuri majore dacă tehnologia scapă de sub control

Specialiștii avertizează că adevăratul pericol va apărea în momentul în care modele similare vor deveni disponibile publicului larg, fără restricții.

În prezent, marile companii tehnologice impun limitări pentru a preveni utilizarea AI în scopuri malițioase. Însă modelele open-source, mai accesibile, recuperează rapid decalajul tehnologic și pot fi modificate pentru a elimina aceste restricții.

Într-un astfel de scenariu, AI ar putea fi folosită nu doar pentru a descoperi vulnerabilități, ci și pentru a genera cod de atac, ceea ce ar schimba radical echilibrul dintre apărare și atac în securitatea cibernetică.

O cursă contra cronometru între securitate și atac

Pentru moment, accesul limitat la modele precum Mythos Preview oferă dezvoltatorilor și instituțiilor timp să își consolideze sistemele de apărare.

Însă experții avertizează că evoluția rapidă a inteligenței artificiale transformă securitatea cibernetică într-o cursă contra cronometru, în care avantajul tehnologic poate schimba balanța în orice moment.

Tags: inteligență artificială, securitate cibernetică, tehnologie